De Google update: BERT

Op 25 oktober introduceerde Google de BERT update.

De grootste Google update in vijf jaar

Met het oog op dagelijks miljarden zoekopdrachten heeft Google op 25 oktober de grootse algoritme-update (BERT) in vijf jaar aangekondigd. De BERT-update is op 10% van alle zoekopdrachten van invloed. Wat is BERT en welke invloed heeft dit op de SEO? Ik vertel je graag meer!

Wat is BERT?

BERT is een algoritme welke is ontworpen door Google. De afkorting staat voor Bidirectional Encoder Representations from Transformers. Het BERT-algoritme helpt met het begrijpen van natuurlijke taal in plaats van SEO-geoptimaliseerde teksten op het web. Door logica achter de (zoek)woorden en combinaties te combineren, zullen de zoekresultaten dusdanig positief gaan veranderen. Het doel hierachter? Betere uitkomsten in de zoekmachine die passen bij jouw vraag.

Wat doet BERT?

Wanneer mensen zoals jij en ik een vraag hebben en het antwoord willen opzoeken in de zoekmachine van Google weten we 9 van de 10 keren niet de juiste manier om de vraag te formuleren. "Zal ik mijn vraag in een gehele zin stellen, of juist alleen met enkele woorden?" De gedachte die hierachter zit is vaak: "Hoe zal Google mijn vraag interpreteren?".

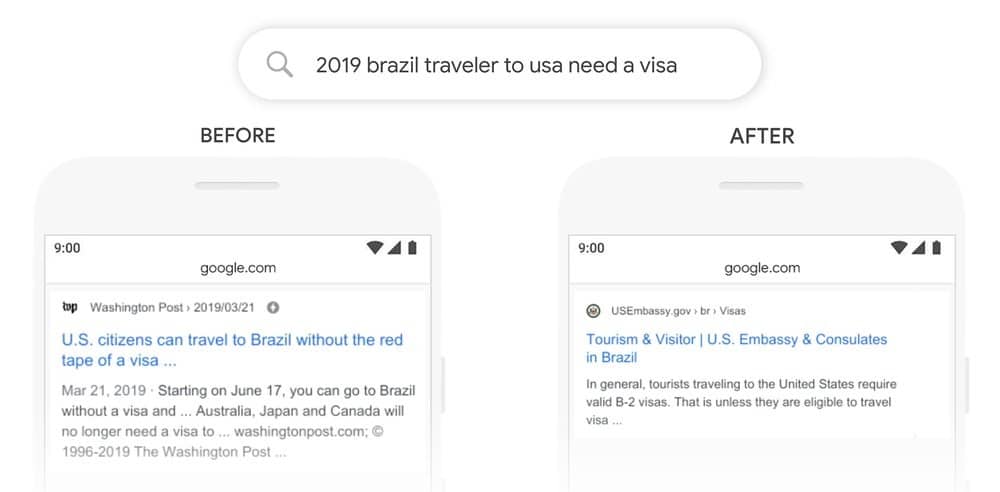

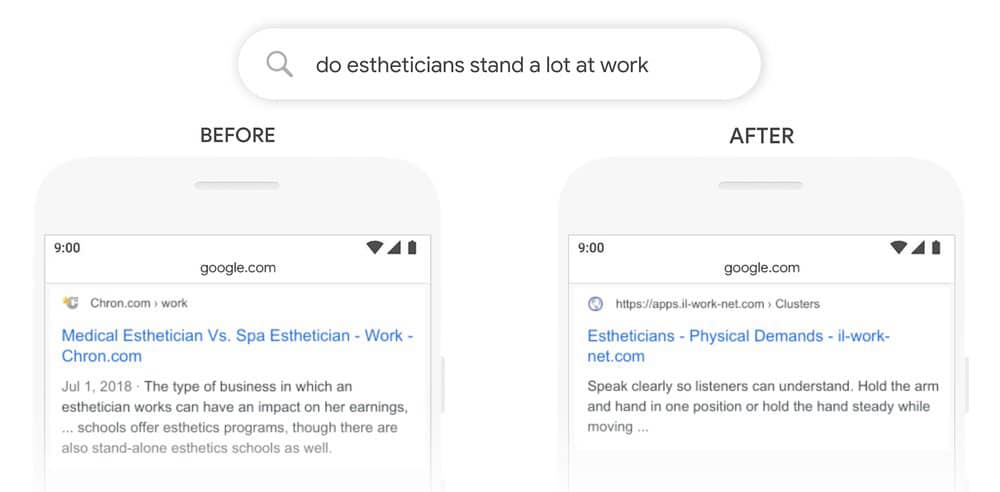

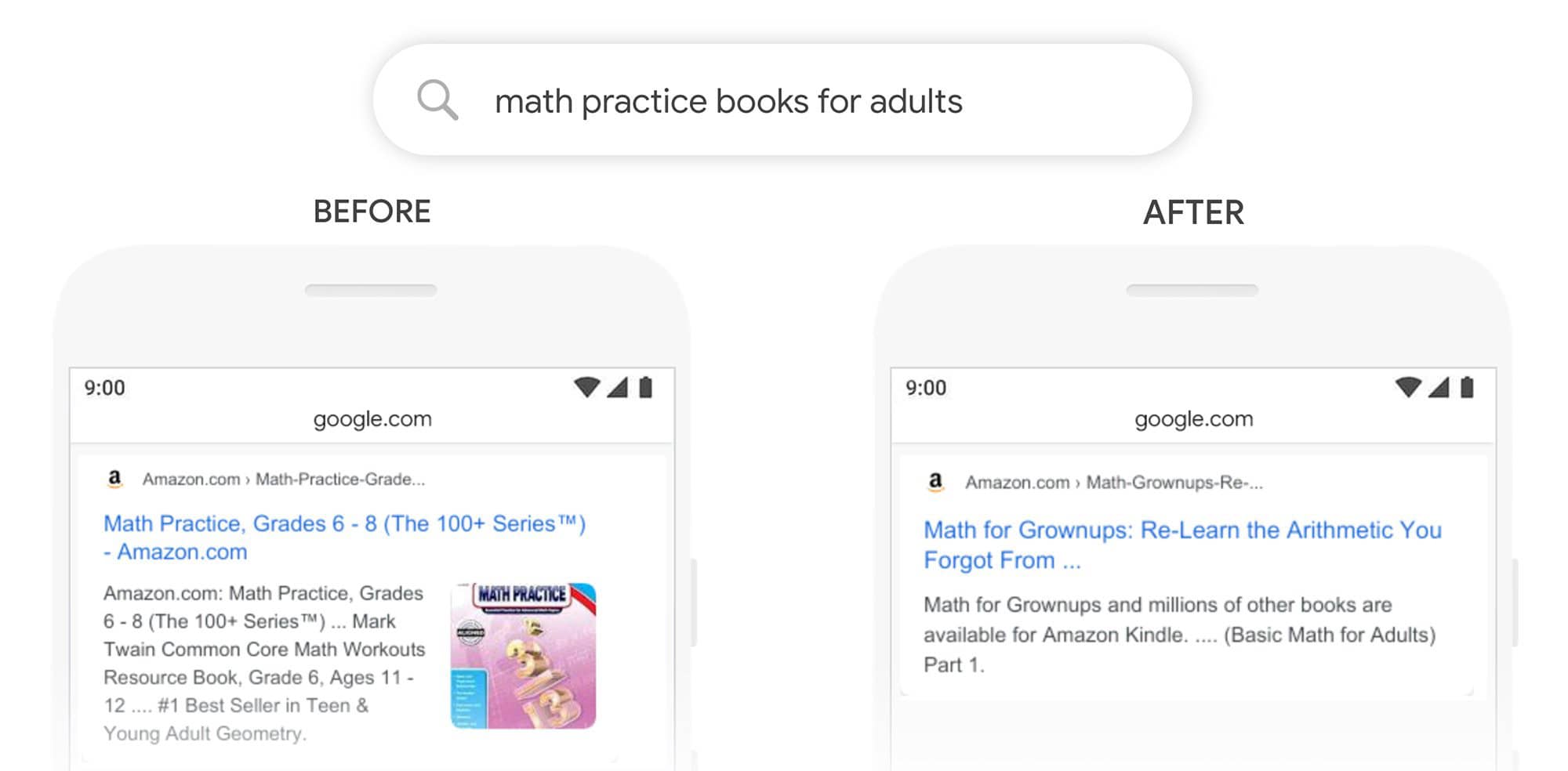

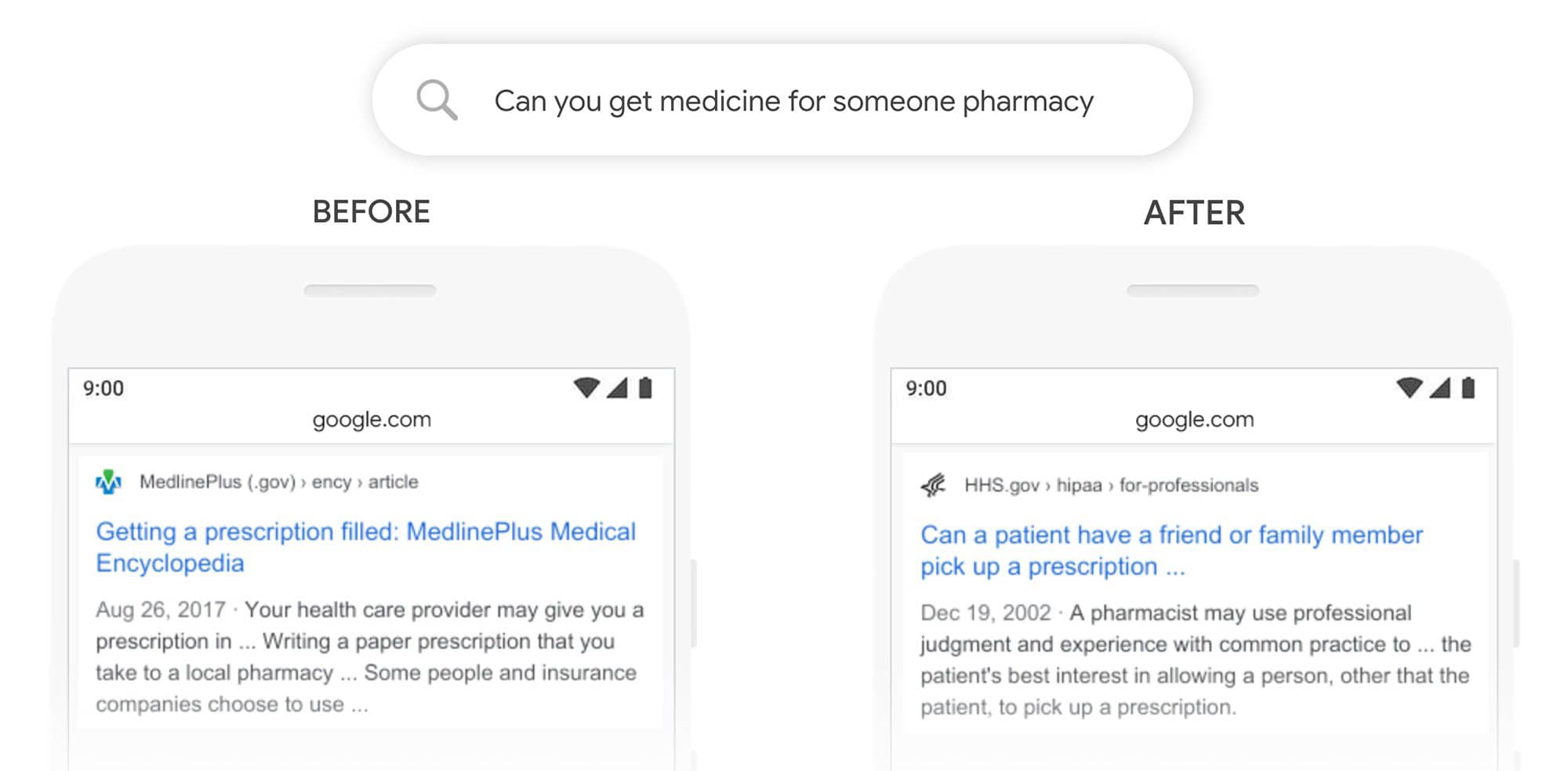

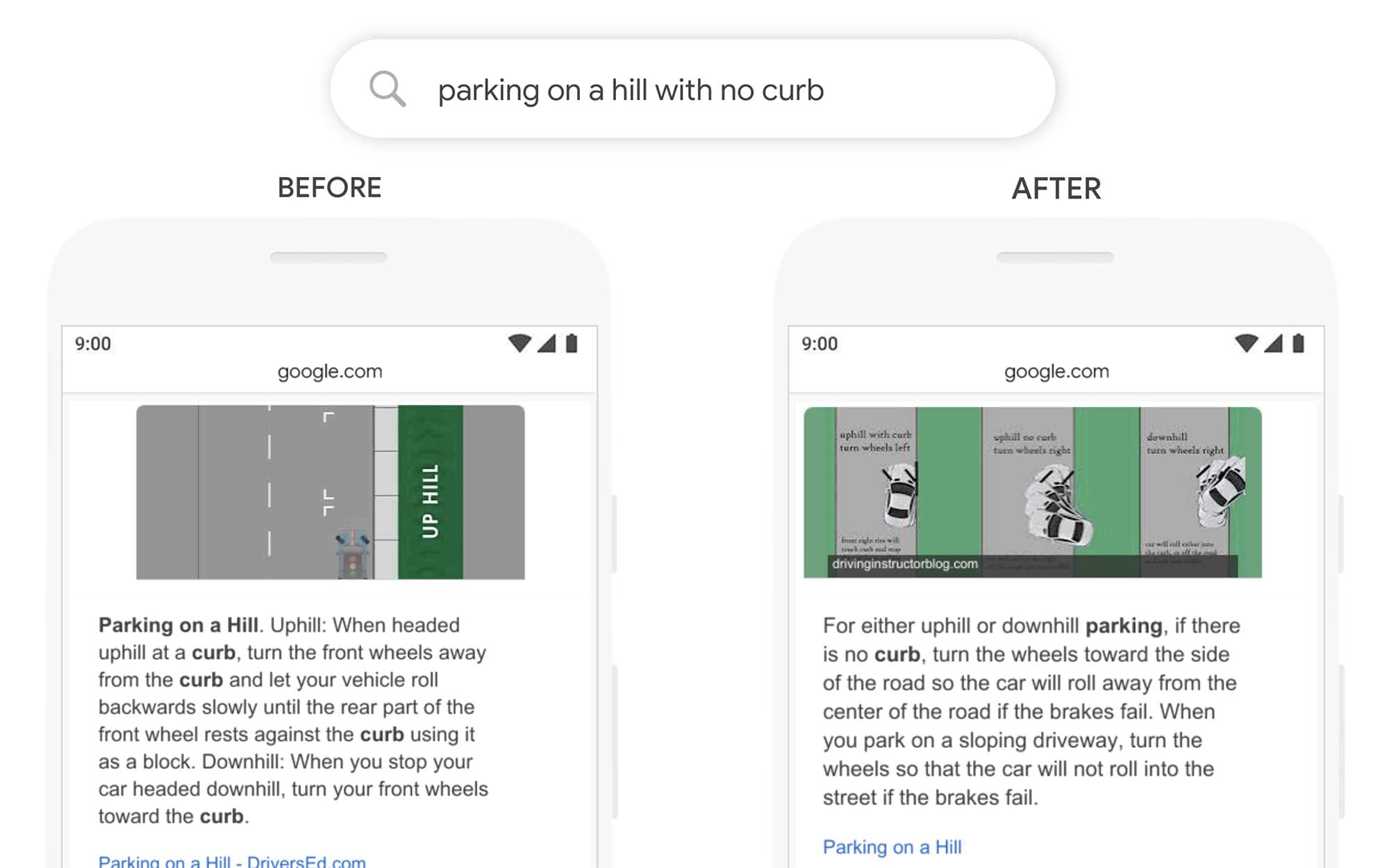

Met de komst van BERT is dit niet langer een pijnpunt. BERT zorgt er namelijk voor dat de volledige context van een woord in overweging wordt genomen door te kijken naar de woorden die ervoor en erna komen. Dat weer nuttig is voor het begrijpen van de intentie achter zoekopdrachten en hierdoor kan Google zoekresultaten tonen die beter aansluiten op de zoekintentie. Zie hieronder enkele voorbeelden.

Welk effect heeft dit op mijn SEO?

Google hechtte al veel waarde aan de inhoud van de website, maar met BERT op komst is mijn advies om de content van de website eens na te lopen en beoordelen op meerwaarde (is dit interessant voor de bezoeker?). Je kunt de website niet specifiek optimaliseren voor BERT.

Wanneer is BERT actief in het Nederlands?

Google gebruikt BERT nu alleen bij 1 op de 10 zoekopdrachten in de U.S. in het Engels. Ze geven aan dit in de toekomst naar meerdere talen en locaties te willen uitbreiden. We wachten het af en zullen je hierover geïnformeerd houden!